自宅で自分を3Dスキャンして踊ってみた。

こんにちは、学部一年の源氏です。

現実の物を3Dモデル化する場合は、フォトグラメトリ、深度センサー、レーザースキャンなどがあるそうですが、今回はフォトグラメトリを使用しました。東京では100台を超えるカメラを使い、精巧なモデルを一瞬で作ってくれるスタジオがあるそうです。田舎にいる僕は、なんとか自宅で自分のモデルを作れないかネットを検索していました。スマホでもできるものがあるそうですが、深度センサーの値段が高く、スマホのフォトグラメトリの場合はモデルのゆがみがひどかったので、パソコンでフォトグラメトリを使用することになりました。

大まかな手順↓

1.フォトグラメトリで自分の3Dモデルを作る

2.腕と脚をスキャン仕切れなかったため、サイボーグ化で解決

3.Unityで踊る

以下詳しく↓

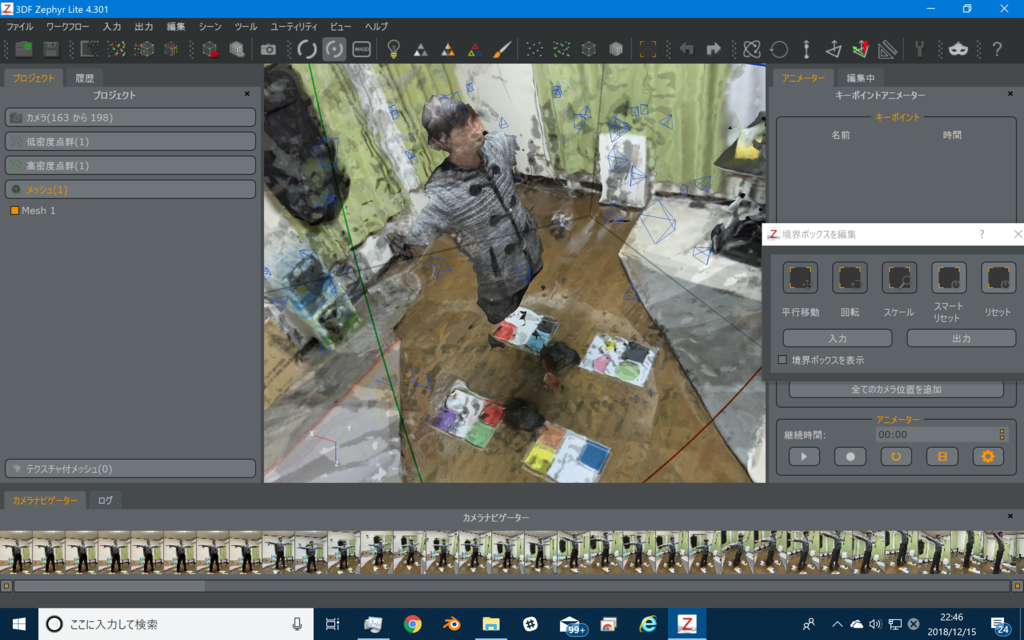

1.フォトグラメトリのソフト「3DF Zephyr」を使用して、自分の3Dモデルを作成する 無料版でも、少ない写真枚数から比較的短時間で、良いモデルを作ってくれるみたいです。僕自身無料版に触れた感覚では、オリジナルと差がないほどのモデルを作ってくれました。しかし、いざ自分の3Dモデルを作ろうと、48+αの視点から写真を撮り解析にかけた結果、出力されたのは、現代オブジェクトと化した”人間だった何か”でした。枚数が少ないのかと思い、500枚まで写真を解析してくれる有料版の無料体験版を利用しました。結果、198枚の写真を撮り、利用できる写真(カメラ位置を割り出せた写真)は160枚でした。

点群データ。

ぱっと見いい感じ。

点群データ。

ぱっと見いい感じ。

メッシュ化してみると……

腕が!?

脚が!?

脚が!?

ない!!!

というわけで、サイボーグ化しました。

ウェイトと脚と腕の比率、モデルのゆがみで色々とおかしいですが、踊っている動画です。

bandicam 2018 12 17 23 28 19 477

反省

腕と脚がなかったのは、撮影しているうちに腕と脚の位置がずれたせいだと考えられます。全ての写真の腕の位置を平均化すると結果ほぼ腕ないみたいな感じなのかな?ちゃんとしたデータがあれば正確なモデルを作ってくれます。ソフトのせいではなく、撮り方が悪かったのです。もしもリベンジするなら、ドローン(もしくは別のだれか)が撮った動画からの写真を使おうと思います。(お金があれば数百台のカメラとスタンドを買うという手があるけど、もう東京のスタジオに行っ方が良い)。